ELF:连续嵌入空间中的流匹配语言模型

论文信息

| 字段 | 内容 |

|---|---|

| 标题 | ELF: Embedded Language Flows |

| 作者 | Keya Hu, Linlu Qiu, Yiyang Lu, Hanhong Zhao, Tianhong Li, Yoon Kim, Jacob Andreas, Kaiming He |

| 机构 | MIT |

| 论文地址 | https://arxiv.org/abs/2605.10938 |

| 代码地址 | https://github.com/lillian039/ELF |

| 发表时间 | 2026年5月 |

一句话概要

论文提出Embedded Language Flows(ELF),一种基于连续时间流匹配的扩散语言模型。

核心洞察是:语言生成可以完全在连续嵌入空间中进行迭代去噪,仅在最终时间步离散化为具体词元。

这一设计使得图像扩散领域成熟的CFG等技术可自然迁移至语言生成。

实验表明,ELF在生成困惑度和采样效率上大幅超越现有离散与连续扩散语言模型,

仅需32步采样即可达到领先水平,且训练数据用量降低约10倍,无需蒸馏。

背景与研究动机

扩散模型和流匹配模型在图像、视频等连续数据生成领域取得了统治性成功。这一进展自然引发了一个关键问题:如何将扩散方法高效地迁移至语言建模。

当前扩散语言模型主要分为两类:

-

离散扩散语言模型:直接在离散词元空间中定义扩散过程,是目前的主流范式,包括MDLM、Duo等代表性工作。

-

连续扩散语言模型:将离散词元映射到连续表示空间,在该空间中进行去噪。然而,这类方法的实证表现长期落后于离散范式。

文中明确提出一个核心开放问题:连续扩散语言模型的性能差距,是否源于语言本质上的离散性,还是由于算法设计空间尚未被充分探索? 这一问题构成了论文研究的根本动机。

现有方法的瓶颈

论文在附录A中通过系统性的文献调查(Table 2),梳理了代表性连续DLM沿多个设计轴线的异同。现有方法的瓶颈可以从以下维度理解:

1. 中间步的频繁离散化造成非必要约束 许多连续DLM(如Diffusion-LM、DiffuSeq、SSD-LM等)在训练或推理的中间步骤中执行离散化操作——将去噪状态映射回词元预测,并施加交叉熵损失。这种设计使去噪轨迹与词元级预测紧密耦合,本质上限制了连续空间中的去噪自由度。

2. 分离的解码器带来系统复杂度 以LD4LG为代表的隐空间扩散方法,通常依赖一个单独训练的解码器来将隐表示映射回文本。这不仅增加了训练阶段的计算开销和系统复杂度,也使得端到端优化更为困难。

3. 离散框架对CFG等成熟技术兼容性差 无分类器引导(CFG)在图像扩散中是控制生成质量与多样性的关键技术,但在离散扩散方法中效果欠佳,应用经验有限。

4. 现有连续DLM的采样效率与生成质量不足 尽管已有连续框架试图改进,但在标准评估协议下,它们的生成困惑度远高于对应离散方法,且通常需要大量采样步数(1024步)才能获得合理质量。

核心洞察与贡献

论文的核心洞察是:语言生成可以不必在每个去噪步都与离散词元空间发生交互。

具体而言,作者观察到连续嵌入空间完全可以作为去噪过程的主体空间,而离散化只需在最终时间步执行一次即可。这一洞察的关键支撑来自两个事实:

- 流匹配框架中,最终时间步(t=1)的自然结果就是干净嵌入,可以自然地与解码操作结合

- 在连续嵌入空间中,所有来自连续扩散领域的成熟技术(如CFG、x-prediction、SDE采样等)都可以直接迁移

基于这一洞察,论文作出以下具体贡献:

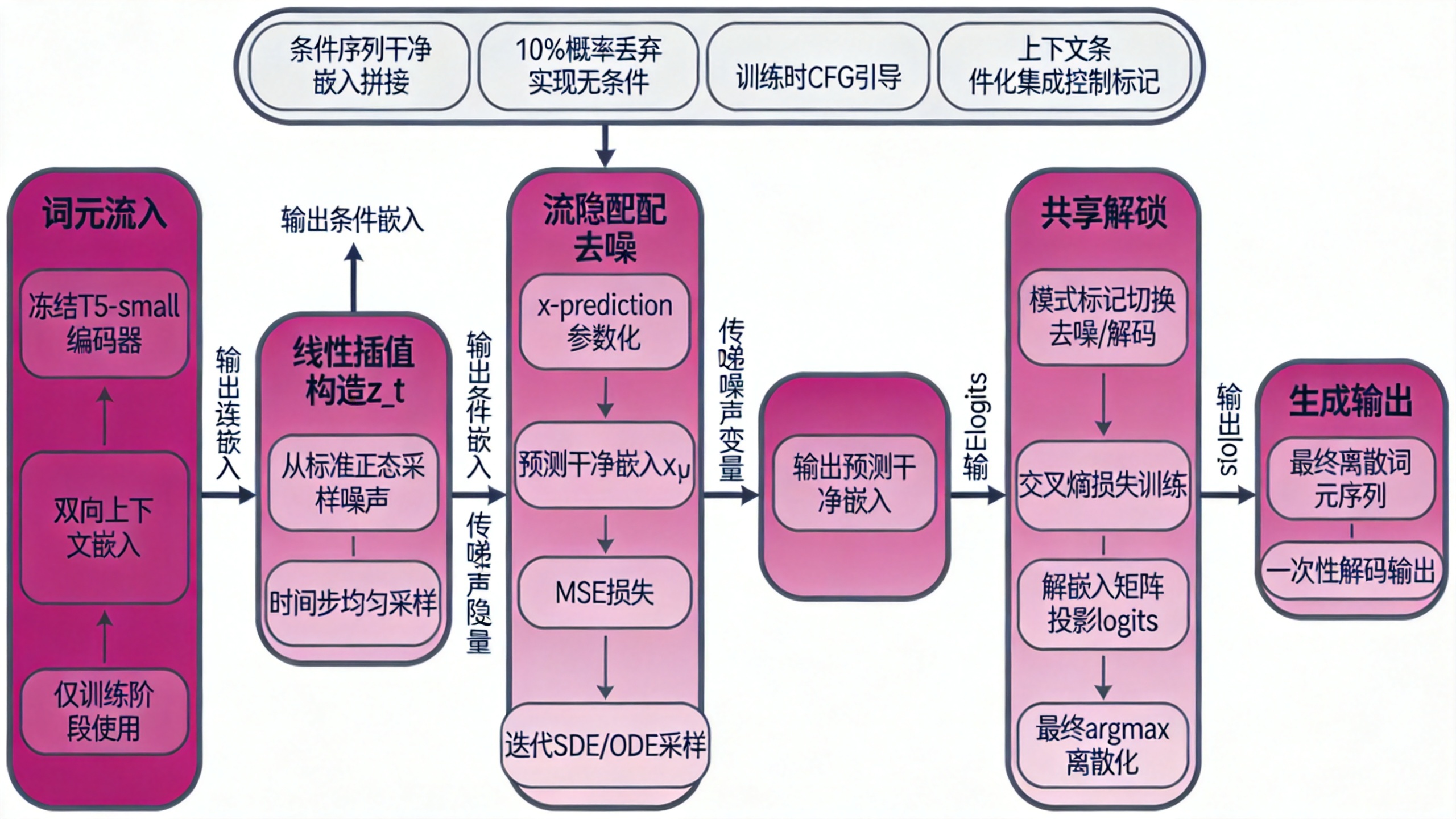

- 提出ELF框架:一个基于连续时间流匹配的连续DLM,在连续嵌入空间中完成几乎全部去噪过程,仅在最终步通过共享权重的网络完成离散化

- 共享权重的去噪-解码设计:单一网络同时承担所有中间步的去噪和最终步的解码,无需单独的解码器,也无需中间步的词元级监督

- 自然集成CFG:由于ELF在连续空间中操作,CFG可以无缝迁移,并通过训练时CFG技术实现单次前向传播的引导控制

- 实证大幅超越现有方法:在标准评估协议下,ELF以更少的采样步数(32步 vs 1024步)和更少的训练数据(45B vs 500B+)取得更低的生成困惑度,且无需蒸馏

方法详解

3.1 从离散词元到连续嵌入

给定词元序列 ,论文使用预训练的编码器将其映射到连续嵌入空间。默认使用冻结的T5-small编码器(35M参数),提供双向上下文的嵌入表示。编码器仅在训练阶段使用,推理时不增加额外模块。

3.2 连续嵌入空间的流匹配

获得连续嵌入分布 后,论文使用流匹配定义从噪声到数据的连续流路径。令 ,线性插值定义噪声隐变量:

流速度 。

x-prediction参数化是方法论设计中的关键选择。论文不直接预测速度 ,而是预测干净嵌入 ,即 。训练损失为:

选择x-prediction的动机是双重的:第一,经验上它在高维嵌入空间(如768维)中长期稳定有效;第二,它自然对齐了最终步解码任务的目标——预测干净词元。若使用v-prediction,在权重共享框架下性能显著下降。

3.3 最终步的离散化

论文引入一种共享权重设计:同一网络在中间步执行去噪(MSE损失),在最终步执行解码(交叉熵损失)。训练时按80%与20%的比例交替执行两种模式。

为了在最终步(t=1)构造有意义的训练输入,论文引入词元级破坏过程:从与去噪分支不同的噪声分布中采样破坏程度 ,形成 。网络将 映射为干净嵌入 ,再通过可学习的解嵌入矩阵 投影为logits:

该网络额外接收一个二值"模式"标记(denoise或decode)作为条件。推理时,仅在最后一步执行 和argmax操作。

3.4 条件生成与CFG

ELF在连续空间中操作,CFG可以直接实现。特别地,论文采用训练时CFG技术:网络直接建模引导组合后的速度场 ,而非引导前的 。回归目标变为:

为实现多种异质条件(时间、CFG尺度、模式标记)的有效集成,论文采用上下文条件化方案:将控制标记直接拼接到输入序列前,通过全自注意力机制处理。相比之下,传统adaLN-Zero方案在条件类型较多时效果欠佳且参数量大。

对于条件生成任务(如翻译、摘要),论文将条件序列的干净嵌入拼接到目标序列之前,在训练中不加噪声。通过10%的概率随机丢弃条件实现无条件预测,为CFG提供基础信号。

实验与结果

实验设置

论文在无条件生成和条件生成两个场景下评估ELF。无条件生成使用OpenWebText数据集(约9B词元),以生成困惑度(Gen. PPL,GPT-2 Large评估)和一元熵作为评价指标。条件生成涵盖WMT14德英翻译(BLEU)和XSum摘要(ROUGE)。

默认配置为ELF-B(105M参数),编码器使用冻结T5-small。训练使用Muon优化器,学习率2e-3,批大小512。训练时去噪模式与解码模式的损失分配为8:2。

核心消融结果

预测目标(x-prediction vs v-prediction vs epsilon-prediction)

论文在附录C.1中系统对比了三种预测目标在不同嵌入维度(512、768、1024)下的表现。x-prediction在所有维度上都保持了稳定的生成困惑度-熵平衡,而v-prediction在512维表现尚可但高维显著退化,epsilon-prediction在所有维度都完全失效。可以理解为,这一模式支持了"高维干净语言数据往往位于低维流形"的假说——直接预测干净嵌入的归纳偏差与数据的内在结构更为契合。

瓶颈维度

实验对比了32、128、512三种瓶颈维度。128维提供了最佳的生成困惑度-熵平衡:32维虽然困惑度更低但熵也低(多样性退化),512维熵较高但困惑度明显恶化。

嵌入选择

预训练上下文嵌入(T5)优于从零训练的编码器嵌入和所有非上下文嵌入(包括冻结高斯嵌入和可学习嵌入)。值得注意的是,可学习嵌入效果最差,论文归因于嵌入与去噪器联合优化的难度。

解码策略

共享权重的去噪解码方案在两个自由度上都优于两阶段分离方案(先单独训练解码器再冻结训练去噪器),并且简化了训练管线。

ODE vs SDE采样

SDE采样在少步数区间(8-32步)显著优于确定性ODE采样,体现了随机性对误差累积的有效抑制。

优化器选择

Muon优化器在相同训练步数下获得了更低的损失和更好的生成困惑度-熵平衡,相比AdamW有系统性优势。

系统级对比:无条件生成

在图7的系统级对比中,ELF以仅32步和24.08的生成困惑度大幅领先于所有对比基线:

- 原始MDLM和Duo需要1024步才能达到接近的困惑度水平

- 经过蒸馏的MDLM+SDTT和Duo+DCD在8-16步区间仍显著落后于ELF

- FLM和LangFlow等连续DLM在全部采样步数配置下表现均明显弱于ELF

数据效率是特别突出的贡献:论文在Table 5中详细列出了各类方法的训练词元消耗。ELF使用45B词元(5个轮次×9.04B),而所有对比方法均使用500B以上(约11×)。ELF仅在45B词元上训练的表现就已超越其他方法在500B+上的结果。

系统级对比:条件生成

在条件生成任务上,论文的Table 1呈现了详细结果:

WMT14德英翻译:ELF-B以26.4 BLEU超越所有同规模基线,包括传统自回归模型(25.2)、MDLM(18.4)、Duo(21.3)、E2D2(24.8)以及CDCD(24.9)。值得注意的是,MDLM在此任务上的表现(18.4)甚至显著差于自回归基准,说明离散扩散在条件翻译场景下存在根本性困难。

XSum摘要:ELF在ROUGE-1(36.0)、ROUGE-2(12.2)和ROUGE-L(27.8)三项指标上全面领先,差距显著且一致。第二好的结果是Duo(31.4/10.1/25.0)和自回归模型(30.5/10.2/24.4)。

批判性评估

基线选择的充分性:论文在无条件生成和条件生成中都涵盖了当前最具竞争力的基线方法。无条件生成包含了MDLM、Duo、FLM、LangFlow四个维度(离散DLM的关键代表和连续DLM的近期工作)。条件生成中额外加入了E2D2、SeqDiffuSeq、CDCD等。覆盖范围是充分的。

实验结论对核心claim的支撑:论文声称"连续DLM只需最小化离散化处理即可取得竞争性效果",核心证据包括:(1) SDE采样32步达到24.08的Gen. PPL;(2) 条件生成全面领先;(3) 训练效率提升约10倍。这三个证据形成的三角验证较为扎实。

需要关注的局限:

- 论文在无条件生成中报告的对比基线困惑度(如图7的纵轴)处于100-500量级,而ELF为24。差距确实显著,但原文对MDLM等基线复现的设置(170M参数、特定蒸馏配置)是否完全公平,需要进一步核对

- 条件生成中的对比基线如MDLM和Duo使用99M-170M参数,ELF-B为105M+35M编码器(140M)。编码器虽冻结但不算入模型参数的方式存在一定的口径差异

- CFG的实验主要在无条件生成中报告(图4、图7),条件生成中的CFG分析仅在附录C.7中简要呈现

优势与局限性

优势:

- 极致的连续化设计:ELF将在图像扩散领域证明有效的"完全连续"范式迁移到语言领域,并在物理直觉上立得住——语言数据通过高质量嵌入表示后,其去噪轨迹应该也是连续的

- 训练与推理效率显著提升:45B训练词元 vs 500B+,32步推理 vs 1024步,两项效率增益共同指向更可持续的大规模部署路径

- 无需蒸馏即可获得少步生成能力:对比方法在4-32步的高效生成高度依赖额外蒸馏训练,ELF直接即可实现

- 技术正交性:ELF并非替代现有方法,而是提供了一个更灵活的基底,未来改进(更好的嵌入、更优的调度、更大的模型)很可能与之兼容

局限性与可复现性:

- 编码器依赖性:ELF的性能高度依赖T5编码器的质量。论文消融结果显示,“从零训练编码器"效果落后于"预训练编码器”,表明该方法的性能上限部分受限于外部编码器

- CFG工作在无条件生成上验证充分,条件生成上的验证尚浅:当前条件生成的CFG分析仅有一个消融图(附录C.7),未系统分析不同CFG尺度下的多样性-质量权衡

- 模型规模上限未充分探索:最大模型ELF-L(652M)仍远小于当前大语言模型的规模。论文虽显示了清晰的扩展趋势(图6),但在更大规模(>1B参数)上的表现仍属未知

- 代码已开源(GitHub),训练配置在Table 4中详细列明,可复现性较好

未来方向与开放问题

- Embedding与去噪器的联合优化:ElF采用冻结T5编码器。未来工作或可探索端到端的训练范式——将嵌入模型与去噪器联合训练,可能进一步提升性能上限

- 更大规模下的行为探索:ELF在数亿参数尺度上表现出与模型规模正相关,在数十亿乃至百亿参数下能否保持这一趋势,是值得关注的问题

- 编码器无关性:能否将ELF适配到无编码器设置(如直接从embedding层开始),仍是一个开放方向

- CFG的离散语言理解:实验展示CFG在ELF中效果显著(调整CFG尺度从0.5到2可系统地改善生成困惑度),但如何在离散扩散框架中复现这一效果,仍是结构性问题

组会预判问答

Q1: 为什么ELF在少步生成上比其他方法好那么多?关键原因是什么?

论文在第3节和第4节通过对比实验和消融研究提供了结构化的证据。关键设计在于:(1) x-prediction——直接预测干净嵌入而非速度或噪声,在SDE少步采样中能有效减少累积误差;(2) 完全连续的去噪轨迹——不引入中间步的词元级监督(交叉熵),使去噪过程不受离散化约束;(3) 上下文条件化实现的CFG——通过训练时CFG在单次前向传播中实现引导控制,无需蒸馏。实验数据显示,这三个设计中的每一个都有单独的消融支持:x-prediction在高维场景下显著优于v-prediction和epsilon-prediction,ODE与SDE消融显示随机性有效提升少步质量,而训练时CFG通过自条件提供强引导信号。

Q2: 对比方法(MDLM、Duo)是否在训练设置上被公平对待?

论文对此做了专门的处理。训练词元对比在Table 5中详细列出,ELF使用45B词元而对比方法使用500B以上。图7的对比不仅比较原始模型,还比较了经过蒸馏的版本(MDLM+SDTT、Duo+DCD),ELF仍然在没有蒸馏的情况下胜出。在条件生成中,论文对MDLM、Duo等完整复现了所有基线,超参数细节见Table 8。一个值得注意的现象是MDLM在翻译任务上(18.4 BLEU)甚至显著低于自回归基线(25.2 BLEU),这可能意味着离散扩散范式在处理条件解码关系时存在特定困难,而ELF的连续框架恰好避免了这一困境。

Q3: 论文声称ELF"不需要单独的解码器",这与隐空间扩散的区别在哪?

与LD4LG等隐空间扩散不同,论文的设计是:同一网络在去噪模式下预测干净嵌入,在解码模式下通过解嵌入矩阵生成logits。这一共享权重方案的关键设计是引入"模式标记"来切换行为。消融实验(图5b)显示,共享权重方案在两自由度上都优于先单独训练解码器再冻结的方案。推理时完全不增加计算负担。这是因为解码器与去噪器在物理上的本质关联——两者都需要掌握从语言表示到离散词元的映射能力——使得参数共享既高效又有效。

Q4: 消融实验中,为什么"可学习嵌入表现最差"?这与直觉相反

论文在第4.1节中对此做了简短解释:可学习嵌入表现最差(图5a),可能源于联合优化嵌入层和去噪器的困难。一种可能的解读是,当嵌入和去噪器共享优化梯度时,去噪器的任务目标(回归干净嵌入)与嵌入层的学习信号之间存在交互耦合,导致优化不稳定。相比之下,冻结高质量预训练嵌入(T5),去噪器只需学习在该固定嵌入空间中的去噪规律,问题空间更清晰。这一现象也暗示,ELF的成功部分建立在已有高质量语言表示(T5)的基础上。

本报告由立理AI生成,仅供参考,请以原文为准。